Uno de los muchos misterios de la mente tiene que ver con el complejo sistema que nos permite comprender el lenguaje. Puedes entender esta oración gracias, en parte, a ese sistema que funciona en tu cerebro. Pero ¿cómo funciona exactamente?

A pesar de usar este sistema todos los días, no entendemos completamente cómo el cerebro da sentido a una secuencia de palabras. En un esfuerzo por pintar una mejor imagen de este proceso, un grupo de investigadores utilizó inteligencia artificial (IA) y neuroimagen para analizar el cerebro de una persona mientras lee.

Los hallazgos publicados en el Journal of Neuroscience revelaron que varias regiones del cerebro trabajan juntas para dar sentido a las oraciones y podrían informar el desarrollo del tratamiento para diversas formas de deterioro cognitivo.

¿Por qué es especial el lenguaje humano?

El lenguaje es una habilidad humana que nos distingue de otros animales. A diferencia de los animales, los humanos tienen una estructura formal para comunicarse. El lenguaje humano nos obliga a crear y utilizar señales de forma flexible, lo que, según los investigadores, es la razón por la que el lenguaje es específico de los humanos.

Los animales tienen sus propios códigos y sonidos para comunicarse en momentos de peligro, cuando encuentran comida y están dispuestos a aparearse. Sin embargo, se comunican a través de actos instrumentales repetitivos que no tienen estructura.

Por otro lado, los humanos tienen una estructura de comunicación formal con dos características distintivas del lenguaje humano, según lo identificado por el Prof. Mark Pagel. Estas dos características distintas son compositivas y referenciales.

La composición proporciona una capacidad ilimitada para generar nuevas oraciones a medida que los humanos combinan y recombinan sus conjuntos de palabras en sus roles de sujeto, verbo y objeto. Permite a los hablantes expresar sus pensamientos en oraciones que constan de sujetos, verbos y objetos con reconocimiento de los tiempos pasado, presente y futuro.

Referencial significa que los hablantes usan el lenguaje para intercambiar información específica sobre personas, objetos, lugares o acciones.

Además, los humanos tienen un sistema de comunicación combinatorio en el que combinan dos o más señales. La combinación de señales es crucial para el poder expresivo del lenguaje humano.

El sistema también es más eficiente que el sistema no combinatorio. Sin embargo, el sistema combinatorio es raro. Solo es aplicable a especies -que no son otras que los humanos- con suficiente capacidad sociocognitiva para entablar una comunicación ostensiva.

La investigación

El estudio analizó la actividad cerebral de catorce personas monitoreadas mediante resonancia magnética funcional mientras leían 240 oraciones diferentes. Estas oraciones habían sido codificadas por InferSent, un modelo de inteligencia artificial entrenado para producir representaciones semánticas de oraciones.

Los escaneos revelaron que se produjo actividad en una red de diferentes regiones del cerebro, lo que indica que, en lugar de que un sitio sirva como centro para la comprensión de oraciones, múltiples regiones corticales trabajan juntas para realizar esta tarea.

Esta IA en particular es significativa porque probó predecir elementos de la actividad de fMRI que no pueden ser predichos por otros modelos computacionales comunes. Esto permitió a los investigadores predecir la actividad de resonancia magnética funcional que refleja la codificación del significado de las oraciones en las regiones del cerebro.

“Los hallazgos brindan una nueva imagen de la red en nuestros cerebros que se dedican a comprender el significado de las oraciones”, dice el investigador principal, Andrew Anderson, PhD, de la Universidad de Rochester. “Como todos sabemos, las oraciones se forman a partir de secuencias de palabras, sin embargo, el significado de una oración es más que la suma de sus partes”.

Anderson señala el ejemplo de “El auto atropelló al gato”. vs. “El gato atropelló el auto”. A pesar de que ambas oraciones contienen las mismas palabras, nuestro cerebro entiende que cada una significa cosas diferentes. El sistema de señalización que nos permite procesar el lenguaje de esta manera es increíblemente complejo, pero la IA puede ayudarnos a comprenderlo mejor.

A través del aprendizaje automático, un modelo computacional puede aproximar el significado del lenguaje. Al hacer coincidir ese modelo computacional con la información de fMRI que destaca la actividad cerebral durante la comprensión del lenguaje, podemos discernir qué regiones del cerebro están activas en esta tarea.

“No se entiende correctamente dónde se codifican tales representaciones ‘holísticas’ de significado cuando se leen oraciones”, dice Anderson. “¿Están localizados en una sola región del cerebro o más ampliamente distribuidos en múltiples regiones? Nuestros hallazgos apuntan hacia lo último, que el significado de la oración está codificado en una red cerebral distribuida, que abarca regiones de la corteza temporal, parietal y frontal”.

¿Qué parte del cerebro procesa el lenguaje?

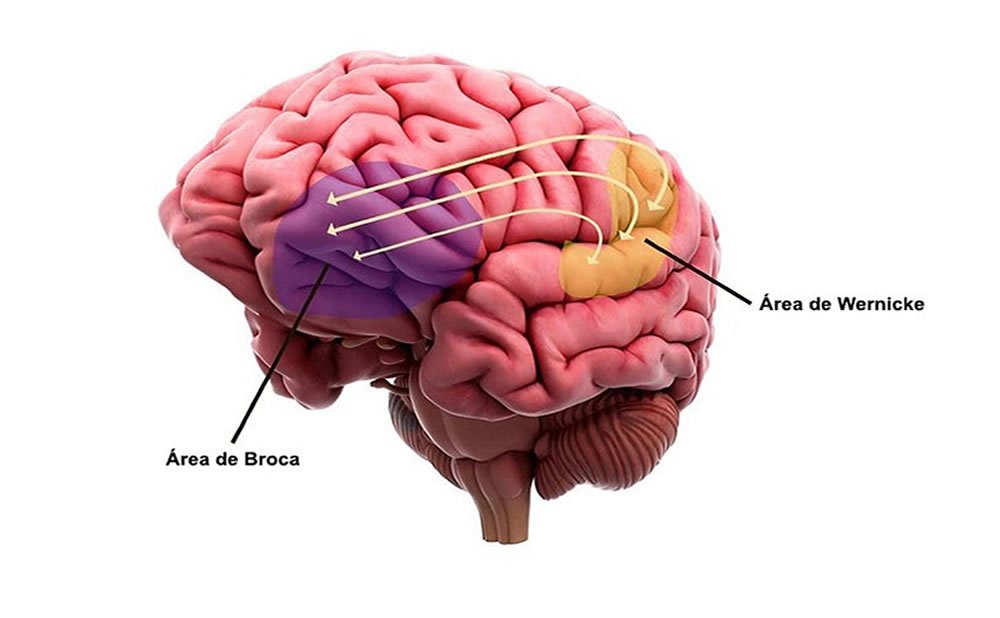

En el hemisferio izquierdo del cerebro hay dos regiones centrales responsables del lenguaje y el habla: el área de Broca y el área de Wernicke, llamadas así por los hombres que descubrieron la función de estas partes del cerebro. Estos científicos descubrieron cómo funciona el cerebro hace años sin la ayuda de monitores y tecnología.

Hoy en día, los EEG y otras pruebas de ondas cerebrales ayudan a los científicos a descubrir un poco más sobre cómo funciona el cerebro. Allie de Neuro Transmissions explica más.

Broca

El área de Broca se encuentra en el lóbulo frontal del cerebro y es responsable del procesamiento del lenguaje. Pierre Paul Broca proporcionó la primera prueba anatómica de qué parte del cerebro era responsable de qué.

Los neurocientíficos dicen que el área de Broca puede comprender el lenguaje a través de recuerdos, significados y emociones. Curiosamente, el área de Broca aumenta la actividad cuando una persona anticipa un error gramatical.

Wernicke

El área de Wernicke no está muy lejos del área de Broca del cerebro. Dos científicos estudiaron el área de Wernicke del cerebro, Carl Wernicke y Norman Geschwind.

Durante el siglo XIX, Wernicke concluyó que esta área del cerebro se descodifica donde se decodifica el significado del lenguaje. Más tarde, Norman Geschwind amplió esta idea y encontró esta área del cerebro donde se descifran la percepción, la comprensión y otras características del lenguaje.

Corteza motora

La corteza motora es la red neuronal que conecta la mitad izquierda y derecha del cerebro. Sin la corteza motora, una persona tendría dificultades para asociar palabras con el habla. El lado derecho del cerebro es donde están los centros visuales y espaciales de un ser humano.

Cuando una persona ve una palabra en una hoja de papel (¡preferiblemente en su libro de bolsillo favorito!), viaja a través de esta red neuronal donde los dos centros del lenguaje la decodifican. Los investigadores ahora creen que la corteza motora podría ser la culpable si una persona tiene problemas con el lenguaje y el habla.

Es una guía práctica y completa que introduce a los lectores en el fascinante mundo de ChatGPT y los modelos de lenguaje. Con un enfoque en la aplicación práctica y las implicaciones éticas, este libro es una referencia imprescindible para aquellos interesados en comprender y aprovechar el potencial de ChatGPT en diversas áreas y contextos.

¿Cómo procesa nuestro cerebro el lenguaje?

La forma en que el cerebro procesa el lenguaje es un proceso complejo, por lo que lo dividiremos en procesamiento de oraciones para que sea más fácil de entender.

El procesamiento de oraciones diferencia tres fases de procesamiento lingüístico después de la fase inicial de análisis acústico. Estas son las fases del procesamiento de oraciones:

Fase 1: Estructura de la frase local

Estructura de frase local es la primera fase de procesamiento de nivel de oración sin restricciones gramaticales y se basa en información de categoría de palabra. Se propone que la información de categorías de palabras sea una guía en la construcción de estructuras de oraciones.

Fase 2: Relaciones sintácticas y semánticas

La segunda fase implica el cálculo de las relaciones entre el verbo y sus argumentos. Este cómputo conduce a la asignación de roles temáticos (quién hace qué a quién) para la interpretación compatible. Una vez que hay una interpretación compatible, se produce la comprensión.

Por ejemplo, es fácil interpretar el sustantivo animado en una oración (John corta ramitas) porque la persona probablemente sea el actor.

Fase 3: Integración de la Información

La fase tres ocurre cuando la información semántica y sintáctica de una oración no se mapea fácilmente. Esta fase implica la consideración final y la integración de diferentes tipos de información, que incluyen contexto o conocimiento de palabras.

La descripción anterior del proceso del lenguaje es solo el proceso básico del cerebro para procesar el lenguaje y comprenderlo.

¿Cómo produce el lenguaje el cerebro humano?

El cerebro humano produce lenguaje aprendiendo la melodía del lenguaje. Aprender la melodía es el primer paso que incluso los bebés dan en el desarrollo del lenguaje al escuchar a otras personas hablar.

La investigación sobre la melodía del llanto de los recién nacidos mostró que los bebés ya nacen sabiendo el sonido y la melodía de su lengua materna. Este conocimiento les permite hablar siguiendo el patrón melódico de la lengua. Es posible que los bebés no puedan hablar con palabras, pero el llanto muestra una cierta melodía.

El estudio presentó los datos recopilados de recién nacidos alemanes y franceses. Descubrieron que los bebés franceses muestran una melodía de llanto que tiene una intensidad baja al principio y luego aumenta lentamente, mientras que los bebés alemanes tienen un llanto de alta intensidad al principio y luego bajan.

Los investigadores encontraron que las melodías de los gritos se asemejan a los patrones de estrés del habla de los idiomas francés y alemán. En el idioma alemán, los alemanes enfatizan las palabras al principio. Por el contrario, el idioma francés tiene acento de palabra al final.

Explicaron además que los bebés aprenden el lenguaje unos tres meses antes de nacer, cuando sus oídos ya están desarrollados. Oyen la voz de su madre y de otras personas hablando. Esto demuestra que escuchar es el primer paso para aprender y producir el lenguaje.

Otras partes del cerebro desempeñarán su papel en la comprensión de palabras y oraciones y en la producción de sonidos. Las habilidades de lenguaje y comunicación se desarrollarán aún más al participar en el habla y la lectura.

IA y nuestros cerebros

Como ilustra este estudio, la IA nos ayuda a comprender mejor el cerebro humano. Al mismo tiempo, estudiar el cerebro humano nos ayuda a desarrollar una IA más sofisticada. Es una relación circular fascinante y beneficiosa.

“Casi todos los avances en IA se han extraído de la neurociencia y la psicología, siendo las redes neuronales profundas y el aprendizaje reforzado quizás los dos ejemplos más destacados”, dice el ingeniero neuronal Dhonam Pemba, PhD.

Pemba ha fundado varias empresas de IA, centrándose específicamente en la educación y la adquisición de idiomas. Más recientemente, cofundó Kidx, una plataforma educativa de IA para niños. Señala que, si bien aprender y pensar como el cerebro humano es el objetivo final de la IA, requiere inmensas cantidades de datos y capacitación para acercarse. La inteligencia artificial no puede generalizar y extrapolar como lo hace el cerebro humano al aprender y procesar el lenguaje.

“Nuestro cerebro para el aprendizaje de idiomas es capaz de impulsar el aprendizaje a partir de conocimientos previos”, dice Pemba. “Por ejemplo, aprendemos patrones de oraciones y podemos usar nuevas palabras en estos patrones sin que se nos diga explícitamente, o podemos aprender el nuevo significado de una palabra más rápido una vez que hemos aprendido otras palabras similares”.

El potencial de las redes neuronales artificiales

Las redes neuronales artificiales han mejorado enormemente los modelos computacionales, y los expertos dicen que se lograrán grandes avances en las tareas de IA basadas en el lenguaje durante la próxima década.

Con más avances en el procesamiento del lenguaje, Anderson cree que eventualmente también alcanzaremos una mejor comprensión de la disfunción cerebral. Usando IA, podría ser posible evaluar cómo las regiones del cerebro afectadas por enfermedades neurodegenerativas como el Alzheimer codifican el significado.

“Además, podemos probar si las redes cerebrales se han reconfigurado para permitir que otras regiones cerebrales menos enfermas asuman el papel de regiones enfermas”, dice. “Esto podría ayudar a caracterizar la progresión de la enfermedad y posiblemente incluso ayudar a pronosticar qué individuos con una fisiopatología alta sucumbirán a la demencia y quiénes no”.

Pero un progreso como este llevará tiempo, y los avances realizados en el campo nunca son perfectos.

“Todavía creo que quedan muchos desafíos para imitar el cerebro humano”, dice Pemba. “Primero, todavía no lo entendemos lo suficiente como para diseñarlo, y segundo, estamos usando la computadora y las matemáticas para representar lo que no sabemos. La clave para mejorar la IA e imitar el cerebro sería permitir que las redes neuronales artificiales aprendan de la misma manera que lo hacen las redes neuronales biológicas reales.

“Pero otra pregunta es si realmente necesitamos imitarlo por completo. Los aviones no vuelan como pájaros”.

Lo que esto significa

Sistemas increíblemente complejos están en funcionamiento mientras lee o escucha el lenguaje. A medida que los avances en inteligencia artificial nos ayudan a comprender mejor estos sistemas, tenemos más posibilidades de comprender y tratar la disfunción cerebral.